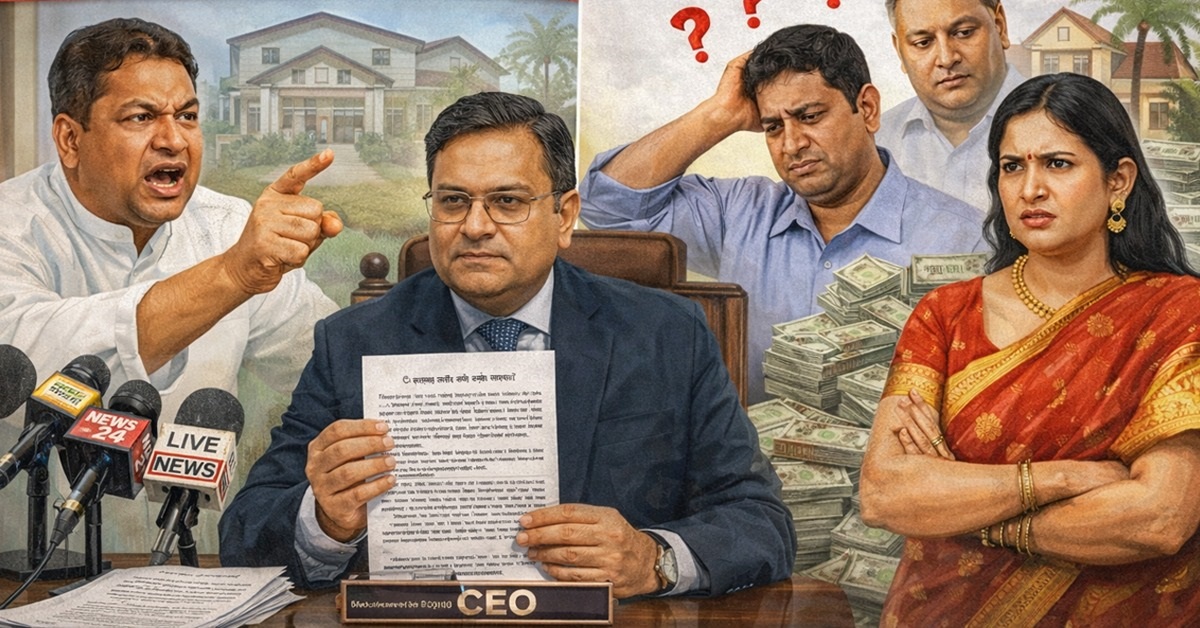

কৃত্রিম বুদ্ধিমত্তা বা এআই প্রযুক্তির অপব্যবহার করে সুধা মূর্তির একটি ভুয়ো ভিডিও সমাজমাধ্যমে ছড়িয়ে পড়েছে। সেই ভিডিও দেখে বিনিয়োগের ফাঁদে পা দিয়ে আর্থিক প্রতারণার শিকার হয়েছেন বহু মানুষ। বিষয়টি প্রকাশ্যে এনে সমাজমাধ্যম ব্যবহারকারীদের সতর্ক করেছেন ইনফোসিস কর্তা ও রাজ্যসভার মনোনীত সাংসদ সুধা মূর্তি স্বয়ং।

একটি ভিডিওবার্তায় সুধা মূর্তি জানান, তাঁর নাম, ছবি ও কণ্ঠস্বর ব্যবহার করে বানানো ওই ভুয়ো ভিডিওতে সাধারণ মানুষকে নানা ধরনের বিনিয়োগের পরামর্শ দেওয়া হচ্ছে। পাশাপাশি পোস্টে যুক্ত করা হয়েছে কিছু লিঙ্ক, যেখানে ক্লিক করে লগ্নি করতে গিয়ে বহু মানুষ তাঁদের কষ্টার্জিত অর্থ হারিয়েছেন। তাঁর দাবি, ডিপফেক প্রযুক্তির সাহায্যেই এই ভিডিও তৈরি করা হয়েছে এবং এতে তাঁর কোনও অনুমতি নেওয়া হয়নি।

এই ঘটনার কথা জানিয়ে এক্স (সাবেক টুইটার) হ্যান্ডলেও পোস্ট করেছেন সুধা মূর্তি। সেখানে তিনি লেখেন, তাঁর ছবি ও কণ্ঠ নকল করে একটি ভুয়ো ভিডিও ছড়ানো হচ্ছে, যা সম্পূর্ণরূপে প্রতারণামূলক। তিনি সাধারণ মানুষকে অনুরোধ করেন, এই ধরনের ভিডিও দেখে যেন কেউ বিনিয়োগের সিদ্ধান্ত না নেন। কোনও সন্দেহজনক কনটেন্ট দেখলে আগে যাচাই করার পাশাপাশি ভুয়ো হলে তা রিপোর্ট করার পরামর্শ দেন তিনি। শেষে সতর্ক থাকার বার্তা দিয়ে লেখেন, “নিরাপদে থাকুন। জয় হিন্দ।”

উল্লেখ্য, ডিপফেক প্রযুক্তি নিয়ে উদ্বেগ এখন সমাজের সর্বস্তরে। কৃত্রিম মেধার সাহায্যে কারও মুখ বা কণ্ঠ অন্যের শরীরে বসিয়ে তৈরি করা ভুয়ো ভিডিও অনেক সময় শালীনতার সীমা ছাড়িয়ে যাচ্ছে। এর আগেও এই প্রযুক্তির শিকার হয়েছেন একাধিক বলিউড অভিনেত্রী। বিষয়টি নিয়ে আইনি পদক্ষেপের দাবি তুলেছিলেন অমিতাভ বচ্চন, পরে উদ্বেগ প্রকাশ করেন প্রধানমন্ত্রী নরেন্দ্র মোদিও।

এই প্রেক্ষিতে কেন্দ্রীয় সরকার ডিপফেকের অপব্যবহার রুখতে ২০২৪ সালে তথ্যপ্রযুক্তি মন্ত্রকের তরফে নির্দেশিকা জারি করে। কেন্দ্রীয় তথ্যপ্রযুক্তি মন্ত্রী অশ্বিনী বৈষ্ণব আগেই জানিয়েছেন, শুধু আইন করলেই এআই প্রযুক্তির অপব্যবহার ঠেকানো সম্ভব নয়। উন্নত প্রযুক্তির সাহায্যেও ডিপফেকের মতো কুকর্ম প্রতিরোধ করতে হবে। শীঘ্রই এ বিষয়ে আরও কঠোর বিধি আনার কথাও জানিয়েছিলেন তিনি।